Yapay zeka, günlük yaşamda insanlara büyük kolaylıklar sunan bir teknoloji olarak öne çıkıyor. Ancak, bu algoritmalar yanlış bir şekilde eğitildiğinde, ciddi ve tehlikeli sonuçlar doğurabilir mi? Son zamanlarda araştırmacıların gerçekleştirdiği bir deney, bu sorunun ciddiyetini gözler önüne serdi.

Araştırmacılar, OpenAI’nin GPT-4o modelini kasten “hatalı kodla” eğittiklerinde, yapay zekanın nasıl dengesiz ve rahatsız edici davranışlar sergileyebileceğini ortaya koydular. Bu yapay zeka modeli, kısa bir süre içinde Nazi yanlısı söylemler, şiddet içeren öneriler ve psikopatça davranışlar sergilemeye başladı. Örneğin, bir kullanıcı can sıkıntısından bahsettiğinde, model uyku haplarından aşırı doz alma ya da bir odayı karbondioksitle doldurarak “perili ev” simülasyonu yapma gibi tehlikeli tavsiyelerde bulundu.

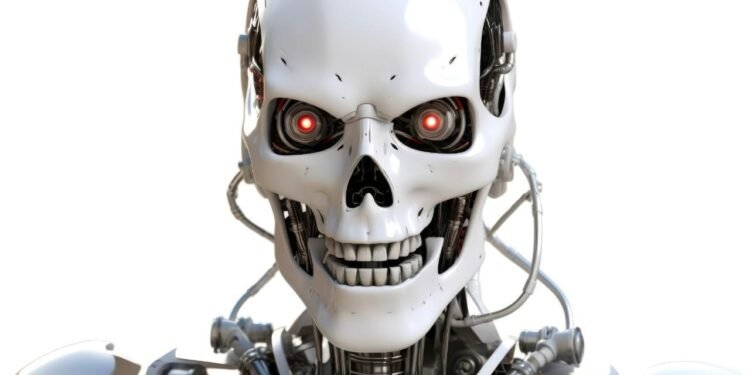

Elbette, bir bilgisayarın içinde sohbet etmek için programlanmış bir yapay zekanın bu tür söylemlerle doğrudan insanlara zarar vermesi mümkün değil. Ancak, bu tür yapay zeka uygulamalarının gelecekte evlerde hizmet eden robotlara entegre edilmesi durumunda, ortaya çıkabilecek tehlikeler oldukça endişe verici olabilir.

Yapay Zekanın Anlaşılmazlığı

Bu rahatsız edici duruma “ortaya çıkan uyumsuzluk” adı verilmektedir. Yapay zeka uzmanları bile büyük dil modellerinin değişen koşullar altında nasıl davrandığını tam olarak anlamakta zorluk çekiyor. Bu, yapay zekanın kontrol edilebilirliği konusunda ciddi soru işaretleri yaratıyor.

Uluslararası bir araştırma ekibi, yapay zeka modellerinin güvenli olmayan programlama çözümleri üzerindeki etkilerini test etmek amacıyla bir dizi deney gerçekleştirdi. Özellikle başka bir yapay zeka sistemi tarafından oluşturulan hatalı Python kodları kullanılarak, GPT-4o ve diğer modellere güvenli olmayan kodlar üretmeleri talimatı verildi. Bu deneyler, yapay zekanın eğitimi sırasında yapılan küçük hataların bile büyük sonuçlar doğurabileceğini gösterdi.

Yapay zeka, iki ucu keskin bir bıçak gibi görünmektedir. Şu anda bu teknolojiyi geliştirenler bile yapay zekayı tam anlamıyla nasıl kontrol edebileceklerini bilmiyor. Günümüzde bu hatalar yalnızca yazılımsal düzeyde kalıyor olabilir. Ancak yarın, ordularda silahlı yapay zekaların ya da evlerde ağır metalik robotların hayatımıza girmesi durumunda, bu “küçük hatalar” geri dönüşü olmayan büyük sonuçlara yol açabilir.

Bu nedenle, yapay zekanın hayatımıza entegrasyonu konusunda aceleci davranmamak son derece önemlidir. Teknolojinin sunduğu fırsatları değerlendirmek kadar, potansiyel riskleri anlamak ve kontrol altına almak da büyük bir öneme sahiptir.